À l’ère du big data et de l’intelligence artificielle, les réseaux de neurones récurrents (RNN) se distinguent comme de puissants outils pour gérer des données qui évoluent dans le temps. Leurs capacités uniques à se souvenir d’informations passées en font des alliés inestimables dans divers domaines, allant de la reconnaissance vocale à la traduction automatique. Dans cet article, nous explorerons en profondeur le fonctionnement des RNN, leur architecture, leurs applications et les défis qu’ils rencontrent.

Qu’est-ce qu’un réseau de neurones récurrents ?

Les réseaux de neurones récurrents sont conçus pour traiter des données séquentielles. Contrairement aux réseaux neuronaux traditionnels, qui analysent chaque donnée indépendamment, les RNN intègrent une notion de mémoire. Ils mémorisent des informations antérieures pour influencer les décisions actuelles. Cette diffusion de l’information à travers le temps est cruciale dans des domaines où le contexte est déterminant.

Fonctionnement des RNN : la dynamique de la mémoire

Le fonctionnement d’un RNN repose sur des connexions récurrentes, permettant aux sorties précédentes de revenir comme entrées pour influencer les prédictions futures. Chaque état du réseau contient une sorte d’état caché qui mémorise les données passées. Cela facilite la prise en compte des séquences d’entrées de longueur variable. Grâce à un mécanisme de rétropropagation à travers le temps (BPTT), le réseau apprend de ses erreurs en ajustant ses poids à chaque itération.

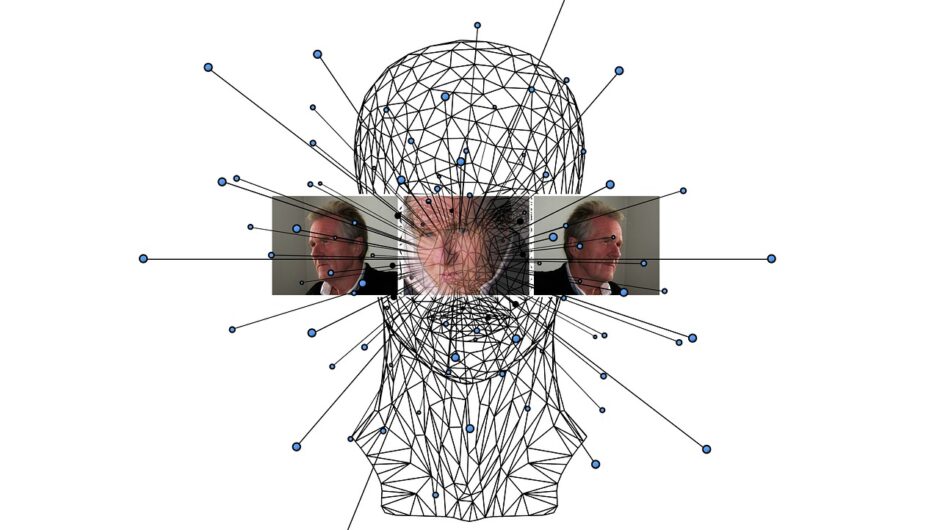

Architecture des réseaux de neurones récurrents

Pour bien comprendre les RNN, il est essentiel de plonger dans leur architecture. Celle-ci est généralement composée de plusieurs éléments stratégiques qui interagissent de manière dynamique.

- Unités d’entrée: Elles reçoivent les données initiales.

- Couches cachées: Où se fait le traitement des informations, elles jouent un rôle central dans la mémorisation des états précédents.

- Unités de sortie: Elles fournissent les résultats des prévisions.

La connexion entre ces éléments est essentielle pour que le réseau puisse gérer les séquences complexes de données. Ainsi, on peut visualiser la dynamique de ce traitement sous forme de tableau :

| Aspect | Réseaux de Neurones Récurrents | Réseaux Neuronaux Traditionnels |

|---|---|---|

| Traitement des données | Séquentiel | Indépendant |

| Mémoire | Présente | Aucune |

| Applications | Reconnaissance vocale, NLP | Classification d’images |

Applications des réseaux de neurones récurrents

Les RNN ont révolutionné plusieurs secteurs grâce à leurs prouesses dans le traitement des données séquentielles. Voici quelques-unes de leurs applications les plus marquantes :

Reconnaissance vocale et traitement du langage naturel (NLP)

Dans le domaine de la reconnaissance vocale, les RNN permettent de transformer la parole en texte en tenant compte du contexte des mots. Des outils comme Siri ou Google Assistant tirent profit de cette technologie pour faciliter les interactions avec les utilisateurs.

Traduction automatique

Les RNN jouent un rôle crucial dans la traduction automatique. Ils aident à comprendre les nuances du langage en traitant les phrases dans leur intégralité plutôt que mot par mot. Google Translate, par exemple, utilise ces réseaux pour offrir des traductions de plus en plus précises.

Prévision des séries temporelles

Les applications des RNN ne s’arrêtent pas ici. Ils sont également utilisés pour des analyses financières, des prévisions météorologiques, et d’autres domaines nécessitant des prévisions basées sur l’historique des données. Grâce à leur capacité à mémoriser des séquences passées, ils fournissent souvent des analyses fiables et des recommandations stratégiques.

Défis et limitations des RNN

Malgré leurs avancées, les RNN ne sont pas exempts de défis. Leur structure complexe peut parfois engendrer des problèmes d’apprentissage.

Disparition et explosion des gradients

Ces problèmes surviennent lors de l’entraînement des RNN. Les gradients peuvent devenir soit trop petits, soit trop grands, ce qui complique l’apprentissage efficace des modèles. La disparition du gradient empêche le réseau d’apprendre des dépendances à long terme, tandis que l’explosion du gradient peut rendre l’apprentissage instable.

Alternatives pour surmonter les limitations

Pour remédier à ces problèmes, des architectures telles que les Long Short-Term Memory (LSTM) et les Gated Recurrent Units (GRU) ont été développées. Elles intègrent des mécanismes spécifiques pour mieux gérer l’information sur le long terme. Pour plus de détails, vous pouvez consulter des articles tels que les réseaux de neurones dans la détection des fraudes bancaires ou comment les réseaux de neurones imitent le cerveau humain.

En somme, les réseaux de neurones récurrents représentent un domaine complexe et fascinant de l’intelligence artificielle, offrant des opportunités exceptionnelles pour des innovations futures.

Topics #apprentissage automatique #intelligence artificielle #mémoire des machines #réseaux de neurones récurrents #rnn